Administración

8 min reading

Ley de IA de la UE: todo lo que necesita saber

¿Quieres saber qué implica la Ley de IA de la UE? Aquí tienes tu guía completa.

Si su empresa desarrolla, compra o utiliza la IA en Europa, el Ley de IA de la UE es ahora una lectura imperativa.

Se aplica no solo a las empresas europeas, sino también a cualquier organización cuya IA toque el mercado de la UE.

En esta guía, aprenderás qué es la Ley de IA de la UE, cómo está estructurada su legislación, el impacto concreto en tu negocio y cómo integrar sus requisitos en tus flujos de trabajo.

¿Qué es la Ley de IA de la UE?

La Ley de IA de la UE es la primera ley integral del mundo para la inteligencia artificial. Establece reglas armonizadas sobre cómo se construye, implementa y supervisa la IA en toda la Unión Europea.

La ley entró oficialmente en vigor el 1 de agosto de 2024 tras su publicación en el Diario Oficial de la UE el 12 de julio de 2024. A partir de ahí, sus obligaciones se van incorporando gradualmente a lo largo del tiempo en lugar de hacerlo todas a la vez.

Verás la Ley referenciada como Reglamento (UE) 2024/1689. Como se trata de un reglamento (no de una directiva), las normas se aplican directamente en todos los Estados miembros sin necesidad de transposición nacional.

Si construyes o integras modelos de IA de uso general (GPAI), la ley añade obligaciones adicionales de transparencia y gobernanza. ¿Una UE Oficina de IA dentro de la Comisión Europea, coordina estas normas, especialmente para la GPAI, y trabaja con las autoridades nacionales en su cumplimiento.

Los requisitos de la Ley se despliegan por etapas. Está en vigor hoy en día, primero se prohíben las prácticas prohibidas, luego se aplican las obligaciones de la GPAI y, más adelante, la mayoría de las obligaciones de alto riesgo. En el calendario oficial se destacan la publicación del DO (12 de julio de 2024) y la entrada en vigor (1 de agosto de 2024), y su posterior aplicabilidad escalonada. La Comisión también ha reafirmado que los plazos se mantienen a pesar de los llamamientos de la industria para que se retrasen.

Legislación y estructura reguladora de la Ley de IA de la UE

Para entender cómo la Ley de IA de la UE da forma a tus obligaciones, analicemos su arquitectura legislativa, las obligaciones clave por nivel de riesgo y cómo se incorpora la aplicación.

Prácticas de IA prohibidas (la «línea roja»)

Algunos usos de la IA están totalmente prohibidos. La ley prohíbe los sistemas de IA que:

- Utilice técnicas subliminales o manipuladoras que distorsionan el comportamiento sin una conciencia consciente.

- Explote a los grupos vulnerables (debido a la edad, la discapacidad o el estatus social) de una manera que cause daño.

- Realice una puntuación social o una clasificación conductual generalizada de manera que resulte en un trato discriminatorio o injusto.

- Utilice la categorización biométrica para inferir rasgos sensibles como la raza, la religión y la orientación (excepto en los usos policiales estrictamente regulados).

Si tu sistema pertenece a una de estas categorías, no está permitido en la UE.

El enfoque basado en el riesgo (lo que se aplica a usted)

La ley clasifica las obligaciones por riesgo, para no exagerar el cumplimiento de las herramientas simples ni subestimar las críticas. A continuación te explicamos cómo leer los niveles y lo que debes hacer.

Riesgo mínimo o insignificante.

Piense en los filtros de spam o en la automatización inocua. No tiene obligaciones legales importantes en virtud de la Ley. Siga adelante, pero siga las buenas prácticas de ingeniería.

Riesgo limitado.

Si los usuarios interactúan directamente con tu IA, como un chatbot o un recomendador, debes asegurarte de que están interactuando con la IA. Haz que esa divulgación sea clara y oportuna en tu experiencia de usuario.

Alto riesgo.

Esto cubre la IA utilizada en áreas de alto riesgo, como la contratación, la educación, la atención médica, la infraestructura crítica y el acceso a los servicios esenciales. En este sentido, se necesita una gobernanza sólida: gestión de riesgos, controles sólidos de calidad de los datos, supervisión humana, documentación técnica, precisión y solidez, registros de auditoría y evaluación de la conformidad previa a la comercialización. Si es un proveedor, espere un trabajo de preparación significativo antes del lanzamiento y una supervisión continua después.

IA de uso general (GPAI).

Si desarrolla o proporciona un modelo amplio que otros adaptarán posteriormente, tendrá que asumir obligaciones adicionales de transparencia y documentación. Es posible que tengas que publicar un resumen de las fuentes de datos de formación protegidas por derechos de autor y mantener modelos de tarjetas e informes de transparencia. En el caso de los modelos con «riesgo sistémico», prepárate para realizar pruebas más exhaustivas y comprobar la solidez de los adversarios.

También puedes optar por ser voluntario códigos de conducta cuando estás fuera del ámbito de alto riesgo o de la GPAI, que es una forma inteligente de demostrar la responsabilidad ante los clientes y los reguladores.

Obligaciones para los sistemas de IA de alto riesgo

Si tu IA califica como de alto riesgo, entran en juego varias responsabilidades, especialmente cuando eres un proveedora. Tendrás que:

- Establecer y mantener sistemas de gestión de riesgos para detectar, evaluar y mitigar los riesgos.

- Garantizar calidad de datos, gestión de sesgos, validación y pruebas de conjuntos de datos de entrenamiento e entrada.

- Producir y mantener documentación técnica (diseño, arquitectura, lógica de control, limitaciones).

- Implementar supervisión humana, para que los humanos puedan intervenir o anular las decisiones.

- satisfacer precisión, robustez, ciberseguridad, fiabilidad requisitos.

- Mantener monitoreo posterior a la comercialización e informar sobre incidentes o averías graves.

- Asignar Marcado CE/evaluación de la conformidad, a menudo a través de organismos notificados de la UE.

En cuanto a desplegadores (quienes usan sistemas de IA), sus obligaciones son más ligeras pero significativas: seguir las pautas de uso, monitorear las operaciones en contexto, mantener registros durante al menos seis meses e informar a los trabajadores y usuarios sobre los riesgos.

Normas particulares para la IA de uso general (GPAI)

Los modelos de GPAI son más que simples herramientas: son infraestructura. Por eso la ley los trata de manera especial:

- Los proveedores deben publicar resúmenes de los datos protegidos por derechos de autor utilizado para la formación.

- Deben mantener la documentación técnica, las tarjetas modelo y los informes de transparencia.

- El modelo debe diseñarse para evitar la generación de contenido ilegal (por ejemplo, incitación al odio o desinformación).

- En el caso de los modelos de GPAI considerados de «riesgo sistémico», es posible que se apliquen pruebas adicionales, comprobaciones de solidez contradictorias y obligaciones de presentación de informes.

Por último, los sistemas que no son de alto riesgo o que no pertenecen a la GPAI aún pueden optar por códigos de conducta voluntarios en virtud de la Ley (Título III).

Gobernanza, cumplimiento y sanciones

Una buena ley es tan fuerte como su mecanismo de aplicación. La gobernanza de la Ley de IA de la UE es escalonada.

Oficina Europea de Inteligencia Artificial y órganos consultivos

La Ley de IA establece una Oficina de IA dentro de la Comisión Europea para supervisar el cumplimiento en toda la UE, especialmente en lo que respecta a la GPAI, y coordinar la aplicación entre las autoridades nacionales. Los órganos consultivos incluyen el Consejo Europeo de Inteligencia Artificial, un panel científico y un foro consultivo.

Autoridades nacionales y vigilancia del mercado

Cada Estado miembro de la UE debe designar autoridades nacionales competentes (organismos de vigilancia del mercado) para supervisar el cumplimiento, realizar inspecciones y hacer cumplir las sanciones. Estas autoridades también designan organismos notificados que gestionan las evaluaciones de conformidad de los sistemas de alto riesgo.

Poderes y límites de ejecución

Las autoridades nacionales ejercen poderes de investigación (solicitudes de documentos, auditorías) en virtud del reglamento 2019/1020 sobre la conformidad de los productos. En el caso de la GPAI, la Oficina de Inteligencia Artificial de la UE tiene la facultad de supervisar directamente. Sin embargo, existen garantías procesales: las solicitudes de intercambio de documentos con los asesores jurídicos internos están protegidas y las empresas tienen derecho a ser escuchadas antes de tomar una decisión.

Sanciones por incumplimiento

Las infracciones se clasifican según su gravedad. Las principales multas incluyen:

- Hasta 40 millones de euros o el 7% de la facturación global para prácticas prohibidas.

- En caso de incumplimiento de la transparencia, la gobernanza de los datos o las obligaciones informativas: hasta 20 millones de euros o el 4% de la facturación.

- Otras infracciones: hasta 10 millones de euros o el 2% de la facturación.

Los organismos públicos, los abogados o los ciudadanos pueden presentar quejas ante las autoridades nacionales. Los reguladores pueden imponer órdenes correctivas, exigir la suspensión de los sistemas de IA o imponer multas.

¿Cuál es el impacto concreto de la Ley de IA de la UE en las empresas?

La Ley de IA de la UE no es una regulación abstracta. Cambia tu hoja de ruta, tu gobernanza y la forma de vender en Europa. Esto es lo que necesita saber.

3.1 Quién se ve afectado

La ley se aplica ampliamente. Vincula a:

- Proveedores — empresas que desarrollan o comercializan IA en el mercado de la UE

- Desplegadores — empresas que utilizan la IA en la UE

- Importadores y distribuidores — empresas que introducen sistemas de IA en la UE o los revenden

También se aplica extraterritorialmente: si tu sistema se usa en la UE, estás dentro del ámbito de aplicación, independientemente de dónde lo hayas construido o alojado.

3.2 Cronogramas de los que debes hacer un seguimiento

La ley entró en vigor el 1 de agosto de 2024, pero las obligaciones se despliegan en fases:

- febrero de 2025 → se prohíben las prácticas prohibidas y se aplican las obligaciones de alfabetización en IA

- agosto de 2025 → entran en vigor las reglas de la IA de uso general (GPAI)

- agosto de 2026 → se aplica la mayor parte de las obligaciones de la mayoría de los sistemas

- agosto de 2027 → La IA de alto riesgo vinculada a las normas vigentes de seguridad de los productos de la UE debe cumplir

Estos plazos son fijos. La Comisión ya ha confirmado que no habrá retrasos generalizados.

3.3 Nuevas obligaciones que debe planificar

Para sistemas de IA de alto riesgo, tendrás que:

- Ejecute un sistema de gestión de riesgos

- Utilice conjuntos de datos de calidad y con verificación de sesgos

- Producir y mantener documentación técnica detallada

- Incorporar la supervisión humana

- Cumpla con los requisitos de precisión, solidez y ciberseguridad

- Mantenga los procesos de supervisión y notificación de incidentes posteriores a la comercialización

- Superar la evaluación de conformidad y colocar el marcado CE

Los proveedores asumen la mayoría de estas obligaciones, pero desplegadores también debe seguir las pautas de uso, mantener registros, monitorear los sistemas en su contexto real e informar a las personas afectadas cuando sea necesario.

Para modelos GPAI, los proveedores deben:

- Publicar resúmenes de datos de formación protegidos por derechos de autor

- Producir informes de transparencia y documentación técnica

- Proteja el diseño contra el contenido ilegal

- Realice pruebas contradictorias si los modelos se consideran de «riesgo sistémico»

Si integras la GPAI en tus productos, tendrás que distribuir estas tareas en sentido descendente y confirmar que tus proveedores las cumplen.

3.4 Las funciones empresariales más afectadas

- Ingeniería y producto → Las canalizaciones de CI/CD ahora incluyen la validación de conjuntos de datos, las pruebas de sesgo, las comprobaciones de solidez, las actualizaciones de la documentación y los registros para su supervisión.

- Legislación y cumplimiento → Archivos de marcado CE, evaluaciones de conformidad, cláusulas contractuales con proveedores y guías de respuesta de los reguladores.

- Gestión de compras y proveedores → nueva diligencia con los proveedores: linaje de datos de formación, informes de transparencia, vías de incidencia.

- Comercial y ventas → el cumplimiento se convierte en una señal de confianza en las RFP. El marcado CE y los informes de transparencia del GPAI pueden acortar las revisiones de seguridad.

3.5 Costos y riesgos

El cumplimiento no es gratuito. Es de esperar que las auditorías, la documentación, la capacitación del nuevo personal y los posibles rediseños del sistema repercutan en el presupuesto. En el caso de las empresas más pequeñas, las plantillas y los códigos de prácticas ayudan a aligerar la carga, pero aun así necesitarás una base de gobernanza básica.

Las multas se escalan rápidamente:

- Hasta 40 millones de euros o el 7% de la facturación global para prácticas prohibidas

- Hasta 20 millones de euros o un 4% por infracciones de la transparencia y la gobernanza

- Hasta 10 millones de euros o un 2% por otras infracciones

Incluso antes de las multas, las investigaciones y las órdenes correctivas pueden interrumpir las operaciones y dañar la reputación.

Cómo integrar la Ley de IA de la UE en sus procesos

No necesitas una tesis jurídica. Necesitas un manual repetible que puedas usar cada trimestre. He aquí una secuencia práctica que puede adoptar hoy mismo.

4.1 Mapee su huella y funciones de IA

Enumere todos los sistemas que usos o provee IA en su producto y en su back-office. Indique quién es usted para cada sistema: proveedora, desplegador, importador, o distribuidora—porque las funciones cambian con el puesto. Los implementadores, por ejemplo, deben usar los sistemas según las instrucciones, asignar la supervisión humana, informar a los trabajadores y mantener los registros durante al menos seis meses.

4.2 Clasifique el riesgo de manera temprana

Coloque cada sistema en los niveles de riesgo de la Ley. Compruebe si es de alto riesgo en virtud del artículo 6/Anexo III (por ejemplo, contratación, educación, servicios críticos). En caso afirmativo, planifique controles estrictos; en caso negativo, anote cualquier obligación de transparencia que limite el riesgo. Mantén este inventario activo y vuelve a comprobarlo cuando cambien las funciones.

4.3 Cree un sistema de gestión de calidad (QMS) ligero

Para los sistemas de alto riesgo, un SGC es obligatorio para los proveedores. Incluye procedimientos para la gestión de riesgos, el gobierno de los conjuntos de datos, las pruebas, la documentación, la supervisión humana, la gestión de incidentes y el marcado CE. Trátelo como una disciplina de producto, no como una carpeta.

4.4 Diseñe la supervisión humana en la UX

La supervisión humana no es una casilla de verificación. Defina quien puede intervenir, cuando ven alertas y cómo anulan el sistema. Documente el uso indebido previsible y las barreras que lo reducen. Coloque estos controles donde los usuarios realmente trabajan.

4.5 Documente como si fuera a ser auditado

Cree documentos técnicos vivos: propósito, limitaciones, arquitectura, fuentes de datos, planes de evaluación y riesgos conocidos. Mantenga los registros versionados y el historial de cambios; los necesitará para la supervisión posterior a la comercialización y, si es de alto riesgo, para la evaluación de la conformidad. Automatice la captura de tanta evidencia como sea posible.

4.6 Prepárese para la conformidad con la CE (cuando corresponda)

Si su IA es de alto riesgo, alinee el evaluación de conformidad camino temprano. Algunas categorías utilizan el control interno; otras involucran a un organismo notificado. No deje la recolección de pruebas para la semana de publicación, sino que la vincule a su CI/CD. Coloque la marca CE cuando cumpla con los requisitos.

4.7 Alinearse con las normas armonizadas

Pista CEN-CENELEC trabajar en los estándares de IA y adoptar los pertinentes a medida que se publiquen. Las normas armonizadas proporcionan una presunción de conformidad, lo que reduce la ambigüedad y la fricción en la auditoría. Asigne a un propietario la tarea de ver las actualizaciones de las normas y traducirlas en listas de verificación.

4.8 Configurar el monitoreo posterior a la comercialización

Decide cómo detectarás los problemas después del lanzamiento: telemetría, informes de errores, comentarios de los usuarios y comprobaciones periódicas de sesgo y precisión. Define cuándo debes notificar a las autoridades un incidente grave y con qué rapidez puedes recopilar los datos. Construya un simulacro ahora; no lo invente durante una crisis.

4.9 Gobernanza de la GPAI (si la utilizas o la ofreces)

Si usted proporciona IA de uso general, prepare resúmenes del contenido de la formación protegido por derechos de autor e informes de transparencia. Haga un seguimiento de los de la Comisión Código de prácticas de GPAI y la plantilla oficial para los resúmenes de datos de formación: firmarlos y usarlos puede reducir la carga de cumplimiento.

4.10 Cree una postura preparada para los reguladores

Conozca a sus reguladores: su autoridad nacional más la Oficina de IA de la UE (especialmente para GPAI). Conserve una única fuente veraz para los documentos y designe un equipo de respuesta. Practique simulacros «sobre la mesa» para poder aportar pruebas de forma rápida y coherente.

4.11 Higiene del vendedor y del contrato

Cuando tú comprar IA, clasificación de riesgos de solicitudes, uso previsto, documentos técnicos, tarjetas modelo, resúmenes de fuentes de datos (para GPAI) y SLA de incidentes. Refleja en los contratos las responsabilidades entre el proveedor y el implementador para que no te quedes sin brechas. Vuelva a evaluar a los proveedores con cada versión principal.

4.12 Vincularlo a su hoja de ruta y a los plazos

Fije su plan a los plazos de la UE: la Ley está en vigor y tiene una amplia aplicabilidad desde 2 de agosto de 2026, y fechas adicionales para la GPAI y otros capítulos anteriores. La Comisión ha confirmado que hay sin pausa—así que secuencia tus huecos ahora

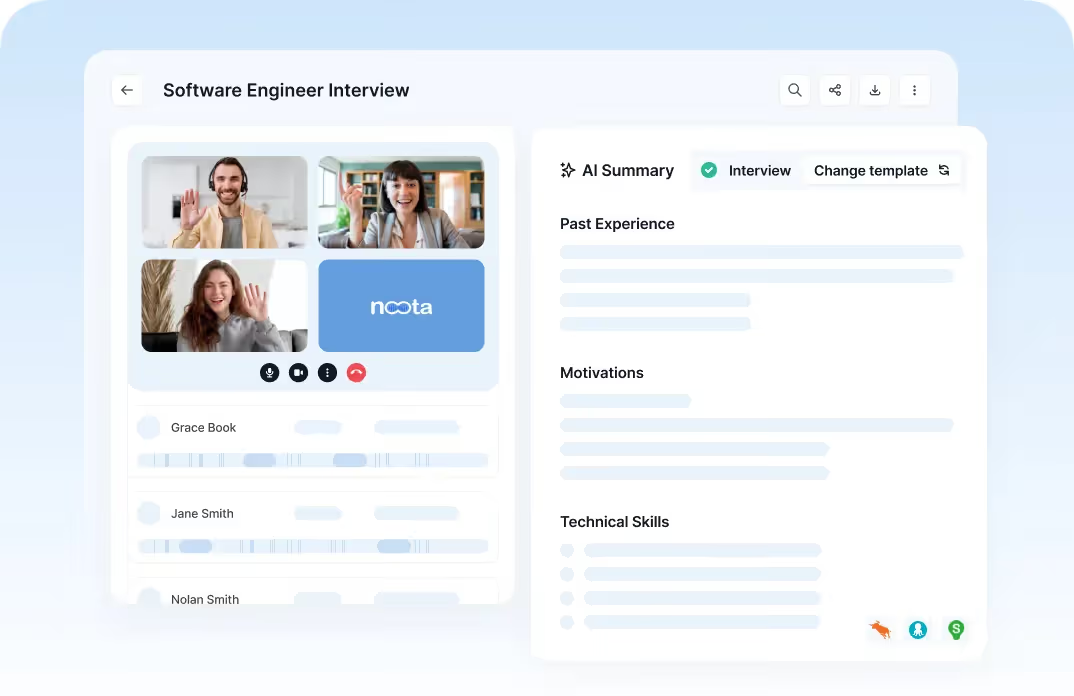

Nota: Tomador de notas con IA compatible con la UE

Noota cifra sus datos de principio a fin y los almacena en Centros de datos de la UE. Se alinea con GDPR y estándares de seguridad empresarial como SOC 2 y ISO 27001, para que su equipo legal pueda respirar mejor.

El producto está diseñado específicamente para reuniones profesionales. Es graba, transcribe y resume en videollamadas, entrevistas telefónicas y conversaciones en persona, para que puedas capturar todos los detalles sin tener que hacer malabares con las aplicaciones.

- La seguridad es lo primero: El almacenamiento cifrado hospedado en la UE con certificaciones reconocidas le ayuda a cumplir los requisitos de residencia y protección de datos.

- Flujo de trabajo transparente: La captura de reuniones, las transcripciones y los resúmenes crean un registro auditable que puede descubrirse durante las revisiones internas.

- Integraciones que respetan la privacidad: Sincronice las notas y los resultados con herramientas como HubSpot manteniendo los datos en la UE y cifrados.

- Idiomas a escala: Transcribe en más de 80 idiomas y traduce a más de 30, algo útil para los equipos de la UE que operan a través de las fronteras.