Gestion

8 min reading

RGPD et IA : ce que vous devez savoir

Si vous étudiez l'IA dans l'UE, il y a une question cruciale à se poser :

Comment tirer parti de l'IA sans enfreindre les règles du RGPD ?

Cet article permet de comprendre quand le RGPD s'applique à l'IA, quels sont les principaux risques de conformité et comment concevoir vos flux de travail d'IA de manière à ce qu'ils soient à la fois puissants et respectueux de la vie privée

Le RGPD couvre-t-il les utilisations de l'IA ?

Oui, dans presque toutes les situations réalistes où vous utilisez l'IA pour traiter des données personnelles, le Règlement général sur la protection des données (RGPD) s'applique.

Le RGPD régit le « traitement » des données personnelles. Le « traitement » inclut la collecte, le stockage, l'analyse, le profilage, la prise de décision automatisée — et oui, c'est exactement ce que font de nombreux systèmes d'IA. Même si votre IA ne touche qu'un nom et une adresse e-mail, ou enregistre des données comportementales (IP, habitudes d'utilisation), il s'agit de données personnelles selon la définition large du RGPD.

Principales dispositions du RGPD pertinentes lors de l'utilisation de l'IA

Si vous intégrez l'IA à vos flux de travail, les règles suivantes du RGPD sont importantes :

- Base légale pour le traitement: Vous devez disposer d'une base légale (consentement, contrat, intérêt légitime ou autre motif valable) avant de traiter des données personnelles avec l'IA.

- Devoir de transparence et d'information: Vous devez informer les personnes concernées de la manière dont leurs données seront utilisées, notamment si elles alimentent l'IA, du type de profilage ou de décisions automatisées qui peuvent avoir lieu et de leurs droits.

- Droits des personnes: Les personnes ont le droit d'accéder aux données, de demander leur correction, leur suppression ou leur restriction, y compris lorsque les données ont été traitées par une IA.

- Règles spéciales pour le profilage/la prise de décision automatisée: Si l'IA prend des décisions concernant une personne (embauche, solvabilité, évaluation, notation des risques, etc.), le RGPD exige des garanties spécifiques : des informations pertinentes, le droit à un examen humain, le droit de s'opposer ou de demander des explications.

- Minimisation des données et limitation des finalités: Collectez uniquement les données strictement nécessaires aux fins de l'IA, et ne les réutilisez pas ultérieurement sans un préavis clair ou un nouveau consentement.

- Obligations de sécurité et de responsabilité: Les responsables du traitement des données doivent garantir une sécurité adéquate (cryptage, contrôle d'accès), les activités de traitement des documents et être prêts à démontrer la conformité.

RGPD et IA — Quels sont les défis et les risques qui se présentent

La mise en œuvre de l'IA conformément aux règles du RGPD présente de grands avantages, mais comporte également des risques de conformité spécifiques.

⚠️ Risque 1 : traitement des données personnelles, même si vous n'en avez pas l'intention

Les systèmes d'IA traitent rarement uniquement des données anonymes. Dans de nombreux cas, ils ingèrent des noms, des adresses e-mail, des journaux comportementaux, des adresses IP, des identifiants utilisateur, des métadonnées, ou déduisent de nouveaux attributs (préférences utilisateur, prédictions, scores). En vertu du RGPD, tout cela est considéré comme des « données personnelles ». L'application d'algorithmes d'IA à de telles données entraîne des obligations standard pour les responsables du traitement.

Même lorsque les données semblent « inoffensives », la capacité de combinaison, d'inférence ou de réidentification de l'IA peut signifier que l'ensemble de données contient soudainement des données personnelles, et le RGPD s'applique pleinement.

⚠️ Risque 2 : manque de transparence et d'explicabilité (IA « boîte noire » contre droits du RGPD)

L'IA est souvent opaque. Les modèles d'apprentissage automatique, les modèles en langage large, les systèmes génératifs fonctionnent avec une logique interne complexe difficile à expliquer sous une forme lisible par l'homme.

Cette opacité va à l'encontre de l'exigence de transparence du RGPD : vous devez informer les utilisateurs de la manière dont leurs données personnelles sont traitées, de la manière dont le profilage ou la prise de décision automatisée sont effectués, et selon quelle logique. Lorsque le résultat de votre IA est une recommandation, une décision ou un résultat de profilage affectant des individus, le manque d'explicabilité peut constituer une violation des règles d'équité et de transparence du RGPD.

⚠️ Risque 3 : le consentement et la validité de la base juridique deviennent difficiles

Le RGPD exige une base légale pour le traitement des données personnelles. Dans de nombreux contextes d'IA, il est difficile d'obtenir un consentement valide : vous devez vous assurer qu'il est éclairé, spécifique, librement donné et révocable. Mais si, par la suite, vous reconvertissez des modèles, réutilisez des données ou si vous les introduisez dans de nouveaux pipelines d'IA, le consentement initial est-il toujours valide ?

Vous pouvez également faire valoir un intérêt légitime, mais cela nécessite un strict équilibre entre vos intérêts et vos droits individuels. Pour le profilage, la notation ou l'IA prédictive, il devient complexe de prouver l'équilibre légal et éthique.

⚠️ Risque 4 : minimisation des données et limitation des finalités par rapport à l'appétit de l'IA pour les données

Le RGPD prévoit deux garanties essentielles :

- Minimisation des données — ne collecter que les données réellement nécessaires à votre objectif.

- Limitation de l'objectif — ne réutilisez pas les données pour de nouvelles utilisations indépendantes sans un nouveau consentement ou une nouvelle base légale.

Mais l'IA prospère grâce aux données : davantage d'entrées améliorent la précision, la modélisation, l'inférence et l'adaptabilité future. Il existe une tension naturelle : si vous alimentez une IA avec de grands ensembles de données « au cas où », vous risquez de les collecter de manière excessive. Si vous souhaitez ultérieurement réutiliser les données pour de nouvelles expériences d'IA, vous risquez de violer la limite de finalité.

⚠️ Risque 5 : conservation, stockage et réplication non contrôlée des données

La formation à l'IA, la journalisation, la création de modèles, les sauvegardes : tout cela peut conduire à un stockage ou à une réplication indéfinis de données personnelles. À moins d'anonymiser ou de pseudonymiser strictement les données, celles-ci risquent de rester dans les archives plus longtemps que ce qui est justifié, ou de se propager dans différents environnements (sauvegardes dans le cloud, ordinateurs portables pour développeurs, journaux).

Cela enfreint le principe de limitation du stockage du RGPD et augmente l'exposition, en particulier en cas de violation ou d'accès non autorisé.

⚠️ Risque 6 : décisions automatisées/profilage et droits individuels

Lorsque l'IA produit des évaluations, des scores, des prévisions ou des décisions concernant des individus (aptitude à l'embauche, risque de crédit, offres personnalisées, profilage des utilisateurs), le RGPD introduit des obligations supplémentaires. Les personnes doivent avoir :

- Informations transparentes sur la logique de décision

- Le droit d'obtenir un examen humain ou de contester la décision

- Le droit de se désinscrire ou de demander une intervention

Si vous ne fournissez pas ces droits, par exemple en masquant la logique de l'IA ou en ne proposant aucun processus de révision, vous vous exposez à un risque juridique et sape la confiance des utilisateurs.

⚠️ Risque 7 : travailler avec des fournisseurs de services d'IA tiers et des sous-traitants

De nombreuses équipes s'appuient sur des fournisseurs d'IA externes, des API d'IA basées sur le cloud ou des outils SaaS. Mais lorsque vous externalisez le traitement de l'IA, le RGPD ne disparaît pas : vous restez responsable du traitement des données et votre fournisseur devient un processeur de données.

Cela nécessite :

- Un accord de traitement des données (DPA) approprié, spécifiant les flux de données, l'emplacement de stockage, la conservation, la notification des violations et les restrictions d'exportation des données.

- Garantit que les données restent dans des juridictions conformes (par exemple, l'UE) et que les sous-traitants respectent les mêmes normes.

- Auditabilité, journaux et contrôle de l'utilisation des données.

Comment mettre votre système d'IA en conformité avec le RGPD

Grâce à une approche réfléchie, vous pouvez créer ou adopter des systèmes d'IA qui respectent la confidentialité, protègent les données des utilisateurs et répondent aux exigences du RGPD

🔍 Étape 1 : cartographiez vos flux de données, déterminez quelles données vous utilisez et pourquoi

Avant de lancer un projet d'IA, commencez par tout documenter : quelles données vous collectez, d'où elles proviennent, comment elles circulent dans vos systèmes, comment elles sont traitées et où elles sont stockées. Cela inclut les entrées brutes, les métadonnées, les journaux, les sorties de modèles, les sauvegardes et tout partage de données avec des tiers.

Cette « cartographie des flux de données » vous aide à identifier où les données personnelles ou sensibles entrent ou sortent de votre système. Il vous permet d'évaluer les risques à un stade précoce et d'appliquer des protections si nécessaire, au lieu de découvrir les problèmes plus tard, lorsqu'il sera peut-être trop tard.

📄 Étape 2 : Choisissez une base légale et définissez un objectif clair

Le RGPD exige une base légale pour le traitement des données personnelles. Pour les utilisations de l'IA, les bases communes sont les suivantes :

- Consentement — lorsque les utilisateurs acceptent explicitement que leurs données soient traitées par l'IA (par exemple à des fins de profilage ou de personnalisation). Le consentement doit être éclairé, sans ambiguïté et révocable.

- Exécution d'un contrat/intérêt légitime — pour les processus internes, la fourniture de services ou les opérations nécessaires, si vous pouvez démontrer que l'utilisation des données est proportionnée et respectueuse des droits.

Vous devez également définir et documenter limitation de l'objectif: indiquez clairement à quelles fins les données seront utilisées et engagez-vous à ne pas réutiliser les données pour des tâches non liées, sauf si vous obtenez un nouveau consentement ou une base légale. Cela réduit le risque d'abus et contribue à maintenir la confiance.

🧹 Étape 3 : Minimiser et anonymiser/pseudonymiser les données lorsque cela est possible

Utilisez le principe de minimisation des données — ne collectez et ne traitez que ce dont vous avez absolument besoin. Évitez de trop collecter des données « au cas où ». Moins vous gérez de données personnelles, plus le risque de conformité est faible.

Dans la mesure du possible, anonymiser ou pseudonymiser données avant de les introduire dans l'IA. L'anonymisation, lorsque les individus ne peuvent plus être identifiés, supprime de nombreuses obligations liées au RGPD. La pseudonymisation réduit les risques et, associée à une sécurité adéquate, vous permet de rester en sécurité tout en bénéficiant du traitement par l'IA.

📢 Étape 4 : Transparence — informer les individus sur le traitement de l'IA

Lorsque des données personnelles sont traitées par l'IA (en particulier le profilage, les décisions automatisées ou la personnalisation), le RGPD vous oblige à informer les personnes concernées. Cela implique de fournir :

- Quelles sont les données collectées

- Pourquoi et comment l'IA le traite

- Quelles décisions ou quels profilages peuvent se produire

- Leurs droits (accès, correction, suppression, opposition)

Utilisez des avis de confidentialité clairs et accessibles. Evitez le jargon. Si les résultats ont une incidence sur les individus (par exemple, notation, classement, recommandation), expliquez-les en termes compréhensibles. La transparence renforce la confiance et contribue au respect des exigences légales.

🛡 Étape 5 : Assurer une supervision des droits et des personnes, en particulier pour les décisions automatisées

Si votre système d'IA prend des décisions ou fait des prévisions qui concernent des individus (par exemple, la notation de solvabilité, l'éligibilité à l'embauche, la personnalisation, les évaluations des risques), le RGPD leur confère des droits :

- Droit d'accès aux données et justification des décisions

- Droit de demander une révision humaine ou une annulation

- Droit de s'opposer ou d'exclure du profilage ou de la prise de décision automatisée

Planifiez un processus de révision ou d'appel: chaque fois que l'IA influence une décision, veillez à ce qu'un intervenant puisse l'examiner et intervenir. Documentez les décisions, mettez à disposition des journaux et autorisez les corrections si les données ou les résultats sont erronés.

🔒 Étape 6 : Utiliser une infrastructure conforme et une gestion sécurisée des données

Où sont hébergées vos données, comment elles sont stockées et cryptées, qui y a accès, tout est important. Pour les organisations basées dans l'UE, privilégiez les outils et les plateformes qui stockent les données dans les centres de données de l'UE, soutiennent le RGPD et s'engagent à respecter les normes de protection des données.

Si vous utilisez des services d'IA ou de cloud tiers, signez un accord de traitement des données (DPA), assurez-vous que les sous-traitants sont conformes et vérifiez que les données ne quittent pas les juridictions de l'UE sans garanties appropriées.

Pour les données sensibles, pensez à IA auto-hébergée ou sur site, ou le déploiement local de modèles open source, ce qui permet de contrôler au maximum la résidence et le traitement des données.

✅ Étape 7 : Tout documenter et auditer régulièrement

La conformité n'est pas une tâche ponctuelle, elle est permanente. Conservez des journaux du traitement des données, des décisions prises par l'IA, des enregistrements de consentement, des diagrammes de flux de données et de tout événement d'accès ou de partage de données.

Des audits réguliers vous aident à détecter rapidement les problèmes : consentement périmé, fuites de données, flux de données inattendus, sous-processeurs non approuvés. En étant proactif, vous éviterez des problèmes plus tard si les régulateurs demandent une preuve de conformité.

Les meilleurs outils et plateformes d'IA conformes au RGPD (ou souverains de l'UE/respectueux de la vie privée)

Les outils d'IA ne sont pas tous égaux en matière de conformité au RGPD, de souveraineté des données et de confidentialité.

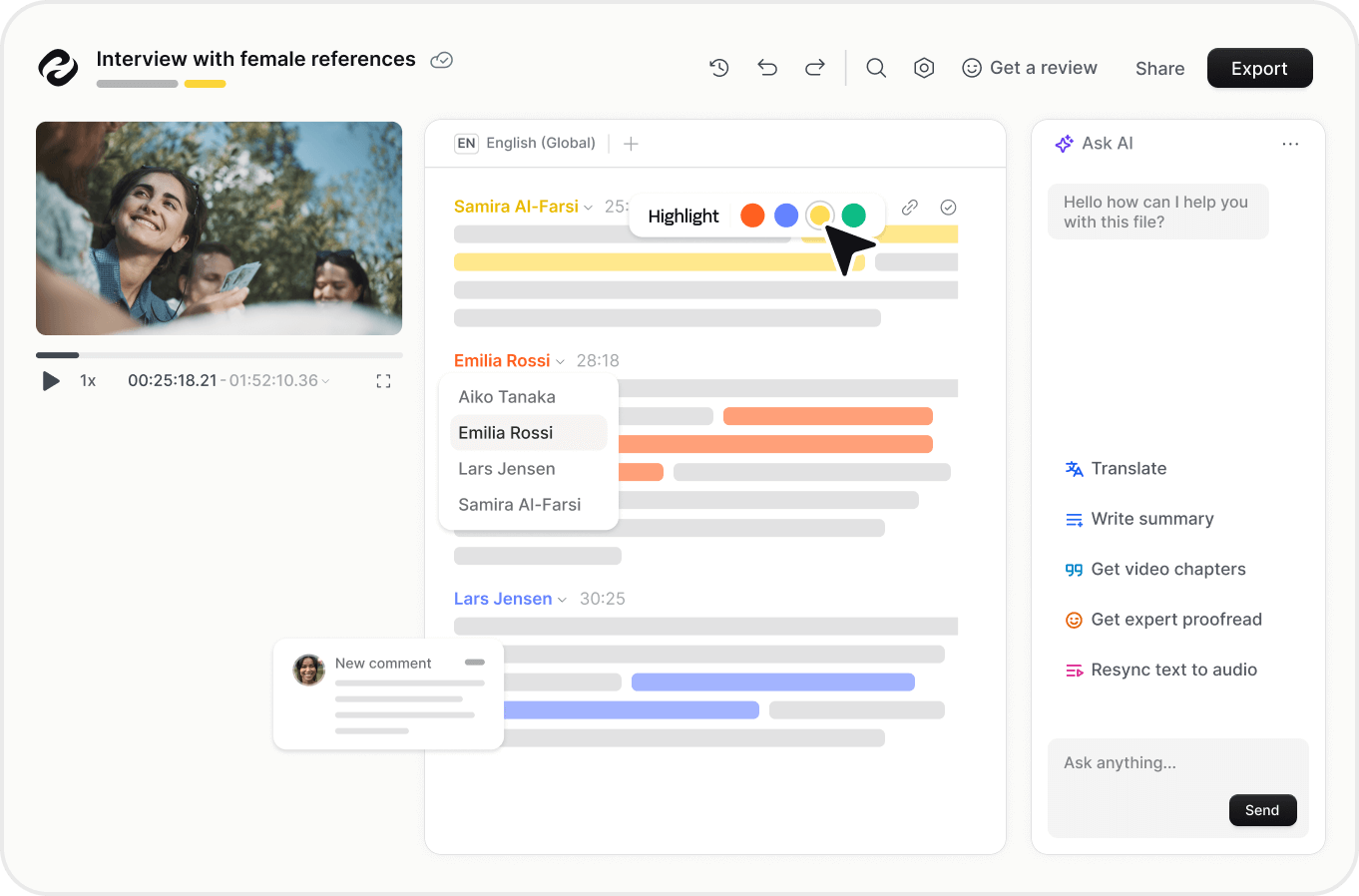

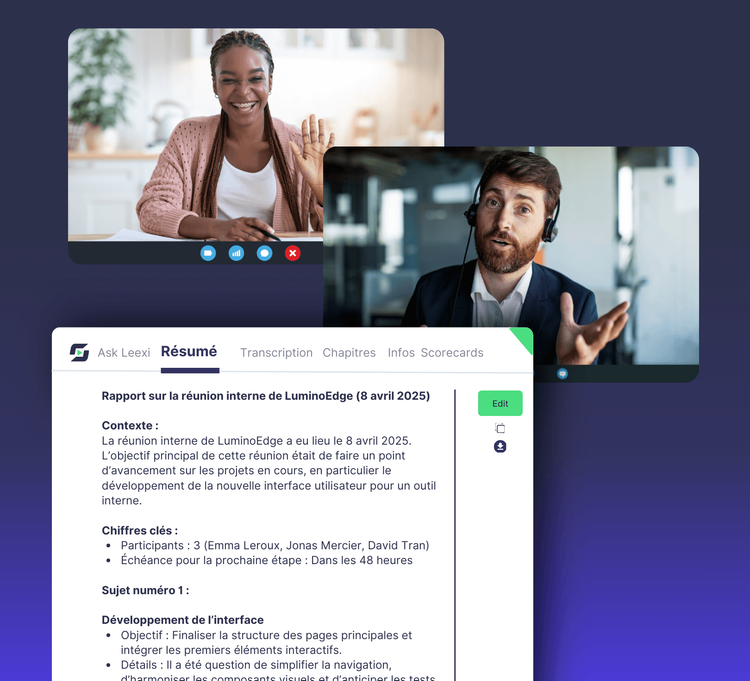

🔹 Noota — outil de transcription et de documentation des réunions, fondé dans l'UE et respectueux de la vie privée

Pourquoi il se démarque

Noota, un assistant d'IA fondé en Europe pour la transcription des réunions et la prise de notes, conçoit son offre dans un souci de confidentialité et de conformité. Pour les équipes qui ont besoin d'enregistrer, de transcrire ou d'archiver des réunions (qui peuvent impliquer des données personnelles), Noota propose une alternative respectueuse du RGPD. Vous évitez de vous fier à des services de transcription opaques hébergés à l'étranger.

Quand c'est un bon ajustement

Des équipes hybrides ou à distance travaillant dans toute l'Europe, des services des ressources humaines gérant les entretiens, les réunions avec les clients, les récapitulatifs internes, etc., partout où des informations sensibles sont discutées. L'utilisation de Noota permet de maintenir le stockage des données, les transcriptions et les archives dans le cadre d'une gouvernance conforme.

ESSAYEZ GRATUITEMENT L'ASSISTANT NOOTA SOVEREIGN AI ICI

🔹 Mistral AI — LLM ouvert avec des options orientées vers la souveraineté

Pourquoi il se démarque

Mistral AI est un fournisseur de LLM européen (français) qui met l'accent sur l'ouverture, la transparence et, surtout, la capacité à s'auto-héberger ou à déployer au sein d'une infrastructure contrôlée. Leurs modèles ne sont pas bloqués par des API propriétaires et opaques accessibles uniquement depuis des juridictions inconnues. Cela vous permet de contrôler où les données sont stockées et comment elles sont traitées.

Quand c'est un bon ajustement

Si vous créez des outils internes, si vous traitez des données sensibles ou réglementées, ou si vous souhaitez éviter l'exportation de données hors de votre contrôle, Mistral vous permet de rester en conformité. Vous pouvez alimenter du texte via leur modèle, l'exploiter sur site ou dans votre propre cloud hébergé dans l'UE, et gérer le flux de données conformément aux règles du RGPD.

🔹 DeepL : une IA de traduction et de langage solidement ancrée en Europe et dotée d'un solide bilan en matière de conformité

Pourquoi il se démarque

DeepL est basé en Allemagne et est largement considéré comme l'un des meilleurs outils de traduction et d'IA linguistique. Pour les entreprises qui ont besoin d'une communication multilingue, de la traduction de documents ou d'une collaboration internationale en Europe, DeepL offre une qualité irréprochable et informations d'identification de conformité.

Quand c'est un bon ajustement

Si vous travaillez dans plusieurs langues (marketing, documentation, support client, équipes internationales) et que vous avez besoin d'un outil de traduction qui respecte le RGPD, la résidence des données et la confidentialité dès la conception.